太难搞了

首先安装qanything

坑一,因为要安装许多境外库,需要配置docker代理

/etc/systemd/system/docker.service.d/ 目录下创建或修改 proxy.conf 文件,加入代理环境变量。

[Service]

Environment="HTTP_PROXY=http://192.168.1.101:50121"

Environment="HTTPS_PROXY=http://192.168.1.101:50121"然后重启system守护进程和docker

sudo systemctl daemon-reload

sudo systemctl restart docker安装

git clone https://github.com/netease-youdao/QAnything.git

cd QAnything

# 选择平台

# 在 Linux 上启动

docker compose -f docker-compose-linux.yaml up

# 在 Mac 上启动

docker compose -f docker-compose-mac.yaml up

# 在 Windows 上启动

docker compose -f docker-compose-win.yaml up

# 安装ollama

docker run -d -v ollama:/root/.ollama -p 11434:11434 --name ollama ollama/ollama

安装千问模型

docker exec -it ollama ollama run qwen2.5:14b

更改模型上下文长度

docker exec -it ollama /bin/bash

ollama show --modelfile qwen2.5:14b > Modelfile

vim Modelfile

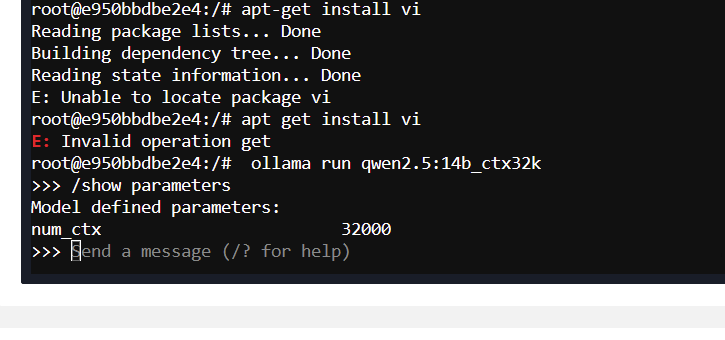

因为docker的bash有概率用不了vim

apt-get update

apt-get install -y vim

结尾追加

PARAMETER num_ctx 32000保存退出

ollama create -f Modelfile qwen2.5:14b_ctx32k查看参数是否生效

ollama run qwen2.5:14b_ctx32k

/show parameters

ollama常见命令如下

1. 启动Ollama服务

ollama serve2. 从模型文件创建模型

ollama create3. 显示模型信息

ollama show4. 运行模型

ollama run 模型名称5. 从注册表中拉去模型

ollama pull 模型名称6. 将模型推送到注册表

ollama push7. 列出模型

ollama list8. 复制模型

ollama cp9. 删除模型

ollama rm 模型名称10. 获取有关Ollama任何命令的帮助信息

ollama help大模型用cpu跑的话很需要大内存建议内存大于64g,

然后就可以在聊天框的设置按钮设置

联网检索能力好像有bug,不要勾选

然后就可以用了